Vogue Leaders

Rozpitvat lidstvo pomocí AI. Josef Šlerka o využití umělé inteligence v humanitních vědách

Danica Kovářová11. 6. 2024

Zatímco my se teď snažíme co nejvíc poznat a pochopit AI, on se s její pomocí chce naopak víc dozvědět o nás, lidech. Expert na analýzu dat Josef Šlerka předpovídá, že nástup umělé inteligence bude mít větší dopad než průmyslová revoluce.

Foto: Adéla Leinweberová

Josef Šlerka

Co pro tebe jako experta je na AI a jejím vývoji v poslední době nejpřekvapivější?

I pro mě je překvapivá ta rychlost, s jakou se vše vyvíjí. Je doslova překotná. Jedná se o intelektuálně jednu z nejzajímavějších věcí, která se za posledních několik desítek let odehrála. Začlenění AI do našich životů a společnosti je srovnatelné s objevem knihtisku nebo s příchodem počítačů a internetu. Baví mě sledovat, jak moc umělá inteligence spoustu lidí zneklidňuje v tom, že zpochybňuje jejich lidskost a schopnosti. Co je vlastně empatie? Co je kreativita? Co znamená, že jsem chytrý? A to, jak rozbíjí jejich představu, že jako bytosti s inteligencí jsme vládci světa! Najednou náš rozum někdo předbíhá brutální rychlostí. Počítače nás předstihly výpočetním výkonem, AI to ale dělá ve všech dalších směrech lidského myšlení. Možná se blížíme přelomovému bodu, kdy zjistíme, že víc lidské než rozum jsou naše emoce, schopnost nenávidět, milovat, vcítit se, vnímat energii druhého apod. Mít prožitky.

Můžeme se na AI spolehnout?

To je moc dobrá otázka, která má složitou odpověď. V prvé řadě je umělá inteligence strašně široký pojem. Pro veřejnost je to ale dnes hlavně Chat GPT a podobné aplikace. Většina lidi si ale myslí, že pro AI platí to samé jako pro kalkulačku, prostě že vždy sečte dvě stejná čísla stejně, jenže to tak není. Může chybovat podobně jako lidé. A také to dělá. Ve své podstatě si ji můžeme představit jako simulátor člověka. Umí podobné věci, dělá podobné chyby, prostě protože se učila od lidí.

Jak ty chyby máme možnost poznat?

Bohužel špatně, protože je často nečekáme. Nesmíme ji brát jako dokonalou databázi ověřených faktů. Když s ní řešíte nějaké faktické věci, je dobré být ve střehu. Ostatně ani když si vyhledáváte na internetu, nepředpokládáte, že všechny odkazy a informace, které naleznete, jsou pravdivé. Ten nešťastný dojem o bezchybnosti vzniká stylem komunikace AI, která vám sebevědomě odpovídá. Je to psychologicky podmíněná důvěra. K AI bychom měli přistupovat s předpokladem, že to, co fakticky říká, je správně, jedině když to my sami poznáme. Jinak bychom měli vždy být předpojatí, raději ji a priori podezřívat z omylu a provádět kontrolu. Podobně jako když nám něco tvrdí člověk. Pokud nevíte, o čem mluví, snadno vás obalamutí, vždy se ale můžete podívat a fakta si ověřit i z jiných zdrojů. Chybou lidí by bylo k výstupům AI přistupovat tak, že jsou skvělé, protože nás nestály žádnou energii.

Ovlivní chybovost nebo bezchybovost výstupů také přesnost člověkem zadaných promptů (správně položená otázka nebo pokyn umělé inteligenci či jiným algoritmům, jako je chatbot)?

Když se dnes generativní AI zeptáte dvakrát na stejnou otázku, neodpoví pokaždé stejně. Podoba promptu hraje zásadní roli, protože ChatGPT a další koneckonců nedělají nic jiného, než že pokračují v tom, co jste napsali. Občas je to chování obzvlášť divné. Ukázalo se kupříkladu, že když zadáš pokyn s dodatkem „Nadechni se a lépe se soustřeď“, následuje přesnější a méně chybová odpověď.

Jak nejlépe prompty formulovat?

Možná tě překvapím, ale myslím, že pro sepisování promptů jsou lidé s humanitním vzděláním lepší než ti, co mají zkušenost s IT. Lépe zasazují do kontextu, ale i lépe výstupy AI vyhodnocují. Je to dáno tím, že v IT znáte jenom 0 a 1, pravdu a nepravdu, algoritmus se provede vždy stejně a tak dále. Nicméně v realitě je to složitější. Při psaní dobrého promptu mějte prostě na paměti, že AI neví nic o tom, co chcete, v jaké podobě, kdo to chce a proč. To jí všechno řekněte a přidejte příklad toho, jak vypadá správný výstup, a budete mít skvělý základ.

Velkým tématem je nyní regulace AI, opatření, která v souvislosti s ní budeme muset zavádět. Jak to vidíš ty?

Nástup AI zasáhne celé lidstvo v drtivé většině oblastí, v tom bych ji přirovnal k průmyslové revoluci. Víme, na jakou dobu to destabilizovalo společnost. Přechod na industriální společnost nás stál britský kolonialismus, ruský a čínský komunismus a nakonec i nacismus. To všechno byly reakce společnosti na příchod nové éry a stálo to mnoho životů. AI bude znamenat podobnou transformaci ve způsobu výroby a naší produktivity. Firma bude najednou potřebovat místo deseti marketérů jednoho, místo pěti právníků žádného. Je to dobrý začátek, může to být i zlý konec. Ty turbulence čekám velké. Už jsme na tu cestu změny nastoupili. Myslím, že teď si budeme ujasňovat, jaké věci nechceme, aby dělala. Které to budou, se teprve uvidí. Myslím, že i v regulacích půjdeme cestou pokusů a omylů, protože je to pro nás celé nová zkušenost. Někde je to jasnější, třeba jako v případě autonomních zbraňových systémů, u kterých je jasné, že je nechceme, ale případnému zneužití momentálně neumíme předejít. Navíc netušíme, co dělají armády v tajném režimu. Podobně vysoké nebezpečí vnímám u autonomních robotů, k jejichž systémům bude mít „někdo“ klíč. Vložení AI do robotů bude přelomové, ale když takový evoluční skok přijde brzy, může dojít k ještě větší destrukci stávající společnosti. V tom se neodvažuju predikovat.

AI už se snaží zablokovat třeba část světových mediálních domů, které odmítají krmit ji datasety se svými texty. Co si o tom myslíš?

Za mě to nedává smysl. AI jejich texty nevykrádá, ona se na jejich datech trénuje, jak může text pokračovat. Je to něco, jako kdyby umělci někdo zakazoval číst cizí knihy, aby se ve své fantazii náhodou neinspiroval.

Co teď kromě problému hodnocení zkoumáš?

Nejvíc mne teď zajímá, jak lze využít AI při zkoumání člověka. Jestli je možné pomocí různých nástrojů, jako je ChatGPT, simulovat lidské zkoumání a dělat s ním pak různé experimenty. Jako příklad můžeš vzít úspěšné rámování. Například jaký bude rozdíl v úspěšnosti, když letáček s výzvou k tomu, že se máme jít očkovat proti černému kašli, začneš větou „95 % lékařů doporučuje“ místo „Lékaři doporučují“. Můžeš také testovat nějaké postupy, s nimiž by šlo zmenšit vlivy takzvaných kognitivních zkreslení. Nebo například se věnovat tomu, jak vhodným nastavením pravidel snížit míru nenávisti v diskuzích online komunit. Je to fascinující oblast. Například se ukazuje, že když člověk podléhající konspiračním teoriím komunikuje s chatbotem, snižuje to jeho víru v ně víc, než kdyby mu je rozmlouval člověk. Podobně lidé s psychickými problémy prozradí při prvním kontaktu se specializovaným chatbotem o sobě a svých problémech daleko víc, víc se otevřou než při prvním sezení s reálným psychologem. Zatím nevíme přesně proč, pravděpodobně je to, protože stroji nemáme tak velký problém se svěřit. Mimochodem, když AI zadáme, aby s pacientem komunikoval empaticky, zvládá to lépe než většina reálných lékařů.

Josef Šlerka v minulosti působil v internetových startupech Ataxo a Socialbakers, kde vedl výzkum a vývoj. Po odchodu z byznysu se stal ředitelem Nadačního fondu nezávislé žurnalistiky, v současnosti je vedoucím oboru Studia nových médií na Ústavu informačních studií a knihovnictví na Filozofické fakultě UK. Ve svém výzkumu se zaměřuje především na analýzu dat ze sociálních sítí a jejich využití pro pochopení lidského chování, sleduje také problematiku dezinformací a konspiračních teorií. Byl jedním z prvních propagátorů digital humanities a nyní zkoumá možnosti využití AI v oblasti humanitních věd. V roce 2014 získal ocenění Osobnost roku v anketě Křišťálová lupa, loni byl součástí týmu, který získal slovenskou Novinářskou cenu za mapování ruského dezinformačního serveru News Front. Podílel se na mnoha výzkumných projektech, včetně OP LZZ a KREAS, je aktivní v norské skupině THREAT‐DEFUSER a projektu OP JAK Beyond Security: Role of Conflict in Resilience‐Building. Během pandemie se stal spoluzakladatelem Centra pro modelování biologických a společenských procesů.

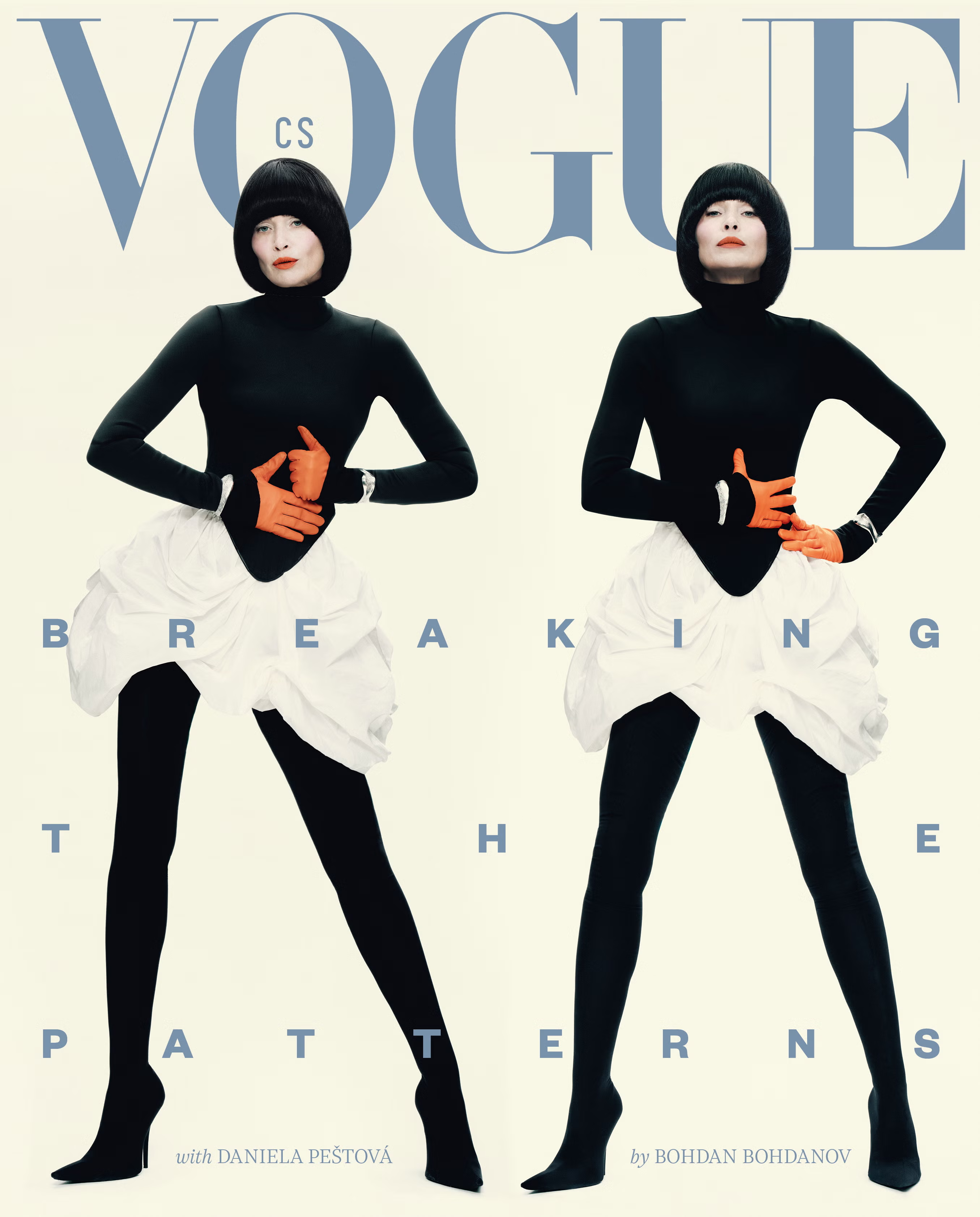

Celý rozhovor si můžete přečíst v nejnovějším vydání Vogue Leaders, které je společně s červnovou Vogue CS právě v prodeji.

Vogue

Doporučuje

Vogue Leaders

Autentická realita je pro mně důležitým zdrojem inspirace, říká kostýmní výtvarnice Laura Štorcelová

Monika Sládková14. 12. 2025

Vogue Leaders

Management umění a designu: UMPRUM reaguje na to, co trh opravdu potřebuje

Jana Patočková13. 12. 2025

Vogue Leaders